Datentransport aus tiefer See via Sonar

Methode ermöglicht Videokonferenzen bei sehr geringer Bandbreite.

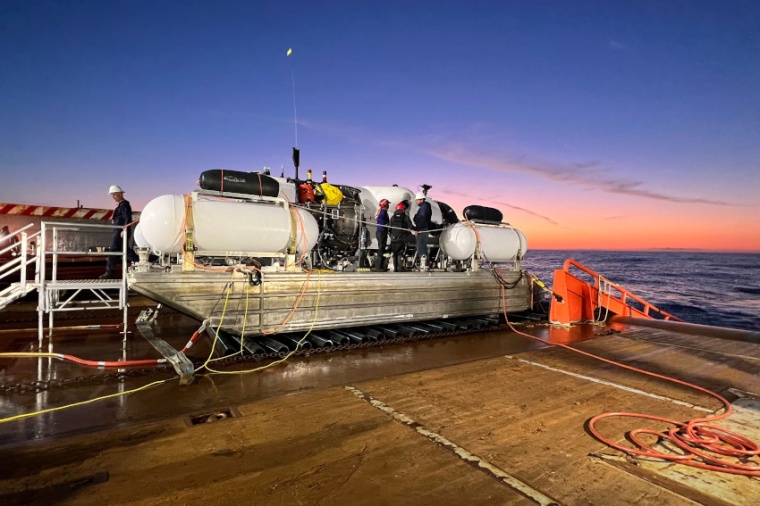

Die Corona-Pandemie hat der Videokommunikation einen enormen Schub gegeben – doch mitunter strapazieren schlechte Übertragungsqualität, Aussetzer und Verbindungsabbrüche in Meetings oder Calls die Geduld der Teilnehmenden. Forschende des Karlsruher Instituts für Technologie KIT und der Carnegie Mellon University (CMU) haben eine Methode entwickelt, mit der Videokonferenzen über sehr geringe Bandbreiten übertragen werden und damit auch unter extremen Bedingungen genutzt werden können. Getestet haben sie diese jetzt während eines Tauchgangs zum Wrack der Titanic in 4000 Metern Tiefe im Nordatlantik.

„Daten aus vier Kilometer Tiefe durch Salzwasser hindurch verlustfrei zu übertragen, ist extrem schwierig“, beschreibt Alex Waibel, der am KIT und an der CMU zur Sprachübersetzung forscht, die Herausforderung. Denn die natürlichen Gegebenheiten ließen eine Übertragung vom Tauchboot an die Meeresoberfläche zum Mutterschiff nur mit Sonar zu, da Radio-Kommunikation im Salzwasser nicht funktioniert. Die Forschenden haben synthetische Methoden entwickelt, mit denen Videos aus Text rekonstruiert werden können. Die Tonaufnahme wird zunächst im U-Boot in Text umgewandelt, dann per Sonar-Schallimpuls nach oben übermittelt und dort aus dem Text als Video rekonstruiert. „Im Video ist dann eine synthetische Stimme zu hören, die auf die Stimme des Sprechers übertragen wird, so dass sie wie die Stimme des Sprechers klingt. Zudem wird die Video Synthese so gesteuert, dass die Lippen des Sprechers sich dabei synchron mit dem Ton bewegen“, sagt Waibel.

Im U-Boot setzten die Forschenden einen leistungsstarken Laptop ein, der zunächst die Sprache unterschiedlicher Sprechenden im Dialog in Text verwandelt. Selektierte Textfragmente können dann via Sonar an die Oberfläche entsandt werden. Dort wird der Text dann wieder zu Video verwandelt. Neu ist dabei die Umwandlung einer synthetischen neutralen Stimme in die individuellen Stimmen der jeweiligen Sprechenden und die Video-Synthese, die lippensynchron das Video der jeweiligen Sprechenden im Dialog synthetisiert. Die Methode erlaubt es, Videokonferenzen über eine geringe Bandbreite zu übertragen: „Das wird in Zukunft die Kommunikation in gesprochener Sprache erleichtern“, sagt Waibel. Sie eignet sich aber auch für die Synthese von Videos in einer anderen Sprache oder für die lippensynchrone Vertonung von Videos.

Die Technologie, die Waibel am Wrack der Titanic getestet hat, baut auf seiner jahrzehntelangen Pionierarbeit in der Sprachübersetzung auf. Waibel entwickelte unter anderem den „Lecture Translator“, der am KIT im Einsatz ist und in Vorlesungen automatisch den Vortrag des Lehrenden aufzeichnet und die Sprachsignale simultan in Schriftform ins Englische übersetzt. Die Studierenden können so über Laptop, Smartphone oder Tablet der Vorlesung folgen.

KIT / JOL