Farben spalten statt filtern

Neuartiges optisches Modul verbessert Signal-Rausch-Verhältnis und die Lichtempfindlichkeit digitaler Bildsensoren.

Bis zu 70 Prozent der Lichtintensität geht in heute verfügbaren Digitalkameras in teilabsorbierenden Farbfiltern verloren, bevor der Bildchip die Photonen detektieren kann. Sehr viel weniger Verluste verspricht nun ein neues optisches Modul, das das Licht vor jedem einzelnen Pixel nach Farben aufspaltet und sortiert. Mit ersten Prototypen erreichten japanische Entwickler bereits eine doppelte Lichtempfindlichkeit im Vergleich zu baugleichen Bildchips mit Bayer-Array-Farbfiltern.

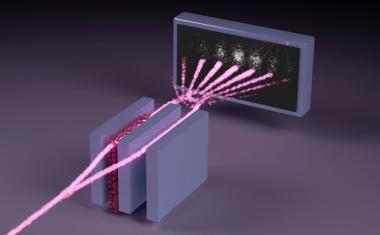

Abb.: Prinzip der Farbfilterung (links) bzw. Farbspaltung (rechts) für hellere, digitale Aufnahmen (Bild: Panasonic)

„Lichtbrechung im Nahfeldbereich ist viel effizienter und nützlicher als bisher erwartet wurde“, sagt Seiji Nishiwaki vom Device Solution Center des Elektronikkonzerns Panasonic in Osaka. Dieses Prinzip nutzte er zusammen mit seinen Kollegen für die deutliche Steigerung der Lichtempfindlichkeit digitaler Bildchips. Das von einem Motiv einfallende Licht traf dabei auf ein winziges optisches Modul aus den transparenten Materialien Siliziumnitrid und Siliziumdioxid, die jeweils unterschiedliche Brechungsindices (SiN: 2,03, SiO2: 1,46) für Lichtwellen im Bereich des sichtbaren Spektrums aufweisen. So wurden die einzelnen Farbanteile – rot, blau und grün – in diesem Modul ähnlich wie in einem Prisma voneinander getrennt und gelangten danach auf die Pixel eines Bildchips. Erste Messungen zeigten, dass sich so selbst bei schlechter Ausleuchtung viel hellere Fotos schießen ließen als mit herkömmlichen Digitalkameras.

Durch die geschickte Anordnung der transparenten Deflektoren aus SiN und SiO2 gelang es Nishiwaki und Kollegen, die roten, blauen und grünen Anteile relativ exakt auf die jeweiligen Farbpixel auf dem Bildchip zu lenken. Damit übernehmen die Licht spaltenen Module die gleiche Aufgabe wie die bisher oft genutzten RGB-Farbfilter der sogenannten Bayer-Arrays. Diese lassen jeweils nur rotes, grünes oder blaues Licht hindurch und absorbieren ungenutzt die andersfarbigen Anteile. Die Folge: Bei dieser Filterung gehen zwischen 50 und 70 Prozent der Intensität des einfallenden Lichts verloren. In den neuen farbspaltenen Module dagegen blieb die Lichtintensität zu fast 100 Prozent erhalten.

Diese Technologie hat laut Nishiwaki das Potenzial, die Lichtempfindlichkeit von Digitalkameras bei konstant bleibenden Auflösung sogar zu verdreifachen. Dazu müssen vor jedem Pixel die farbspaltenden Module optimal positioniert werden. Technisch ist dieser Prozess mit verfügbaren Produktionsverfahren prinzipiell schon heute umsetzbar. Und mit mehr als 20 Patenten hat sich Panasonic die Rechte für diese viel versprechende Technologie gesichert.

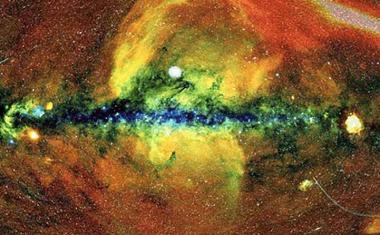

Abb.: Vergleich der Helligkeit zwischen Digitalaufnahmen mit verfügbarer Farbfiltern (links) vor den Pixeln und den neuen farbspaltenden optischen Modulen (rechts; Bild: Panasonic)

Die Bedeutung dieser Farbspaltungs-Module wird zudem parallel zum Trend zu weiter schrumpfenden Bildpixeln zunehmen, da bei über 20 Millionen Bildpunkten pro Sensorchip ein immer kleinerer Lichtanteil auf jeden einzelnen Bildpunkt entfällt. Denn mit kleineren Pixel mit Kantenlängen um etwa 1000 Nanometern steigt der Anteil an störenden Einflüssen an, verursacht durch das Photonenrauschen. Auch für diese Herausforderung, das Signal-Rausch-Verhältnis für zukünftige Megapixel-Chips möglichst groß zu halten, sind die Farbspaltungs-Module geeignet. So könnte eine Fortsetzung der Pixeljagd, die mit klassischen Farbfiltern langsam an ihre Grenzen stoßen würden, möglich werden. Wann allerdings eine erste Digitalkamera mit Farbspaltern statt Farbfiltern auf den Markt kommen wird, konnten die Entwickler noch nicht sagen.

Jan Oliver Löfken

Weitere Infos

Weitere Beiträge

OD