Räume per Radar dreidimensional erfassen

Neues Verfahren soll Objekte lokalisieren und ihre Zusammensetzung bestimmen.

Neue Signalverarbeitungsverfahren für die Bildgebung und Materialcharakterisierung mittels Radar haben Forscher der Universitätsallianz Ruhr entwickelt. Langfristiges Ziel ist es, diese Techniken mit der radarbasierten Ortung von Gegenständen zu kombinieren. Die Vision: eine fliegende Plattform, die selbstständig eine dreidimensionale Repräsentation des umgebenden Raums erzeugen kann. Nützlich könnte die Technik zum Beispiel sein, um bei einem Brand herauszufinden, was die Feuerwehrleute hinter den Rauchwolken im Gebäude erwartet.

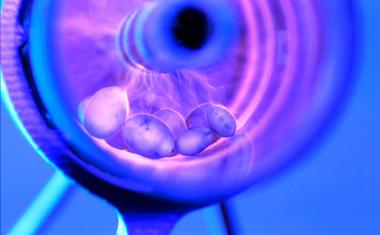

Abb.: In diesem abgeschirmten Raum können die Forscher ihre Systeme unter kontrollierten Bedingungen testen. (Bild: R. Schirdewahn)

Prinzipiell taugt das gleiche Messverfahren für die Materialcharakterisierung und die Ortung. Nur wird es derzeit noch nicht gleichzeitig für beides eingesetzt. Das Prinzip: Ein Radar strahlt elektromagnetische Wellen ab, die an Objekten reflektiert werden. Grob gesagt lässt sich aus der Laufzeit der eingestrahlten und zurückgeworfenen Signale berechnen, wie weit ein Gegenstand entfernt ist.

In den zurückkommenden Wellen steckt aber noch mehr Information. Denn die Stärke des reflektierten Signals hängt davon ab, wie groß ein Objekt ist, wie es geformt ist und aus welchem Material es besteht. Eine Materialkonstante, die relative Permittivität, beschreibt, wie durchlässig eine Substanz für elektromagnetische Wellen ist. Aus der Permittivität können die Forscher also Rückschlüsse darauf ziehen, um welches Material es sich handelt.

Ein Radarsignal in ein aussagekräftiges Bild umzuwandeln erfordert hohen Rechenaufwand. Die aufgezeichneten Daten sind etwa so wie von einer Kamera, der die Linse zum Fokussieren fehlt. Die Fokussierung erfolgt nachträglich im Computer. Algorithmen für diesen Prozess entwickelte Jan Barowski an der Uni Bochum. „Als ich angefangen habe, hat eine solche Korrektur noch zehn Stunden gedauert“, sagt er. Heute läuft die Auswertung über eine Laptop-

Das aktuell vorliegende System kann in einer kontrollierten Laborumgebung bereits erkennen, wo ein Objekt ist und dass es aus einem anderen Material bestehen muss als zum Beispiel der Untergrund, auf dem es liegt. Im nächsten Schritt wollen die Forscher das System befähigen zu erkennen, was das Objekt ist. Die Permittivität von Kunststoffen können sie bereits gut bestimmen, aber zum Beispiel noch nicht zwischen verschiedenen Kunststoffen unterscheiden. Schritt für Schritt wollen die Projektpartner das System nun für den Einsatz unter realistischen Bedingungen optimieren.

RUB / RK